经过2个月的时间,我们已经完成了11.0的更好人声提取算法的研发。新算法的特性正如伴奏人声提取的11.0算法介绍那样,基于DangoNet5架构的11.0更好人声提取,带来了更好的提取性能、全新的“立体声”修复模块,以及“前所未有”的饱满听觉。

性能再次提升

10.0中,我们训练得到了11.65dB的SDR分数,而本代我们得到了12.12dB的SDR分数,相对提升了0.47dB的SDR分数,SDR即为“生成的声音和真实声音的相似度”,越大越好,这得益于和伴奏人声提取一样的额外30%训练素材的引入,以及我们的全新的“权重训练”模式,让AI在遇到困难提取的音频中更多、更专注的学习,而在轻松提取的音频里放低学习能力,就像是让学生在有限的“刷题”时间内去刷一些困难题,而不是大多数注意力在一些简单题一样。

现在新的算法在遇到前代算法中容易把乐器混淆成人声的歌曲中,会更加谨慎的分辨人声和乐器的存在。

全新“立体声”修复模块

我们在DangoNet5架构的研发时就设想过,大多数的歌曲为立体声的歌曲,根据歌曲的制作,左右的声道会有些不同,但也有相同点,是否可以利用立体声作为输出的“互补”?当某一声道的提取效果不佳时,可以从另一个声道学习并“补偿”?

团子的之前的架构(包括市面上一部分“开源”的源分离架构)是立体声敏感的,也就是双声道将一起输入到分离架构,而不是单独输入(拆分或放入Batch通道),这也意味着架构将隐式的学习一些立体声的特征并“可能”学习到一些补偿的特性。

我们在研发DangoNet5时,希望网络能加强立体声的补偿学习能力,并增加了一系列的“显式”的约束架构,我们发现这不太能提升伴奏的输出性能,但能显著提升人声的输出性能,这和我们主观的预测一样,伴奏大多数是立体声丰富的,也就是左右声道经常“不一样”,当一个声道的伴奏出现损伤,很难从另一个声道去“借鉴”补偿,而人声一般除效果器外,大多数是声道居中的,也就是“左右耳”相同,这能极大的提升补偿的能力。

这意味着在歌曲中,某个声道的乐器破坏了该区域的人声,网络可以从另一个声道的相同人声中寻找更简单的补偿,使得人声的整体输出性能大幅度提升,并极度减少了10.0(以及更古老的)出现的提取出的人声在某些情况下突然在某个声道“缺”声音导致恍惚感的问题、或者某个声道出现一块残留而另一个声道没有(大多数是低音的轰鸣),导致输出不干净的问题。

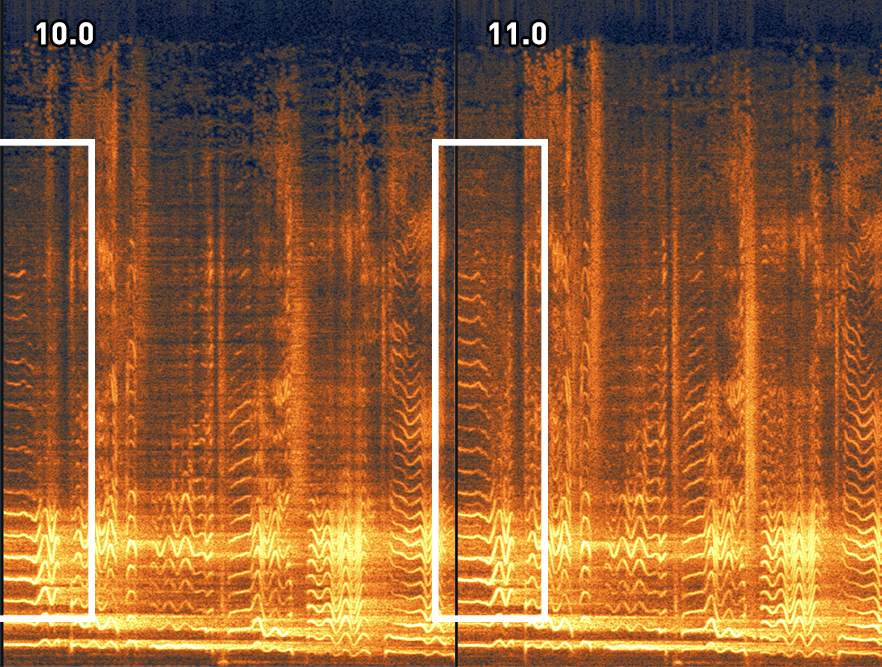

(从上到下分别是:原曲,10.0输出,11.0输出)

在上面的示例中,可以很明显的听出10.0的人声输出会存在原曲的一些Bass残留,而11.0的输出则没有残留的“恍惚感”,这得益于立体声的人声左右声道的互相学习和补偿,有效的提升的输出的性能。

杜绝失真,真饱满输出

在前代算法中,当遇到乐器吵闹或人声较小的情况下,尽管仍能提取内容,但提取的内容会严重“退化”且失真,或者人声的效果器破损缺失,本代我们延长了架构的注意力机制,可以更好的提取人声的长拖尾、效果器(如混响、延迟器)的声音。

得益于DangoNet5架构的提升,现在输出的人声即便是“智能”模式,也相较于10.0的“保守”模式更加饱满,同时不会增加残留。

上图为有损压缩文件的提取情况,即便在有损文件情况下,11.0算法对人声的泛音提取能力更强,人声频谱形状更加完整。

高级修复正在路上

我们将为11.0的更好人声提取算法也同样应用高级修复功能,即便算法默认提取出现残留或缺失、并且三种输出(保守、智能、激进)仍无法改善时,您可以选择高级修复对歌曲某一个片段进行重新提取,让一切的“问题”即刻解决,无需“等待下个版本修复”😇